È arrivato Mistral Large 2, che porta un nuovo livello di sofisticatezza ai modelli linguistici. Con i suoi enormi 123 miliardi di parametri e un’impressionante finestra di contesto da 128.000 token, questo modello può gestire testi lunghi e conversazioni complesse con facilità. È progettato per essere preciso, riducendo gli errori nelle informazioni e al contempo eccellendo nella codifica e nelle attività multilingue.

Scopri come le funzionalità avanzate di Mistral Large 2 stanno ampliando i confini di ciò che l’intelligenza artificiale può fare, dalla risoluzione di problemi matematici al supporto di un’ampia gamma di linguaggi di programmazione.

Mistral Large 2: una panoramica completa

Mistral Large 2 rappresenta un significativo progresso nel campo dei modelli linguistici, combinando dimensioni considerevoli con tecnologia all’avanguardia. Ecco perché.

Finestra di scala e contesto del modello

Mistral Large 2 si distingue per i suoi 123 miliardi di parametri. I parametri sono i componenti principali di un modello linguistico, che gli consentono di apprendere e generare testo in base a pattern trovati nei suoi dati di training. Il vasto numero di parametri consente a Mistral Large 2 di comprendere e generare testo più complesso e sfumato.

Il modello presenta anche un’ampia finestra di contesto da 128.000 token. Questa ampia finestra di contesto significa che Mistral Large 2 può elaborare e generare testo mantenendo la coerenza su passaggi molto lunghi, rendendolo efficace per la gestione di documenti lunghi e conversazioni dettagliate.

Una delle principali sfide dei modelli linguistici è la generazione di informazioni plausibili ma non corrette, note come allucinazioni. Mistral Large 2 è stato specificamente addestrato per ridurre questo problema. È progettato per riconoscere quando non ha informazioni sufficienti, anziché generare contenuti potenzialmente fuorvianti. Questo miglioramento aumenta l’accuratezza e l’affidabilità del modello.

Prestazioni sui benchmark

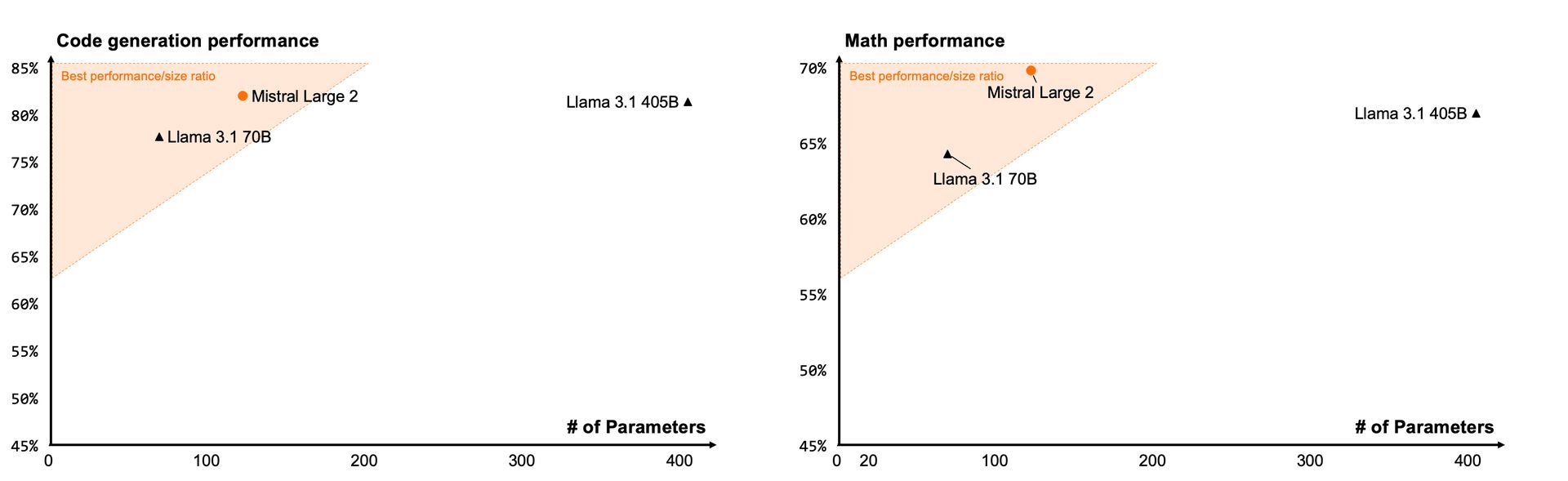

Mistral Large 2 ha dimostrato ottime prestazioni in vari benchmark:

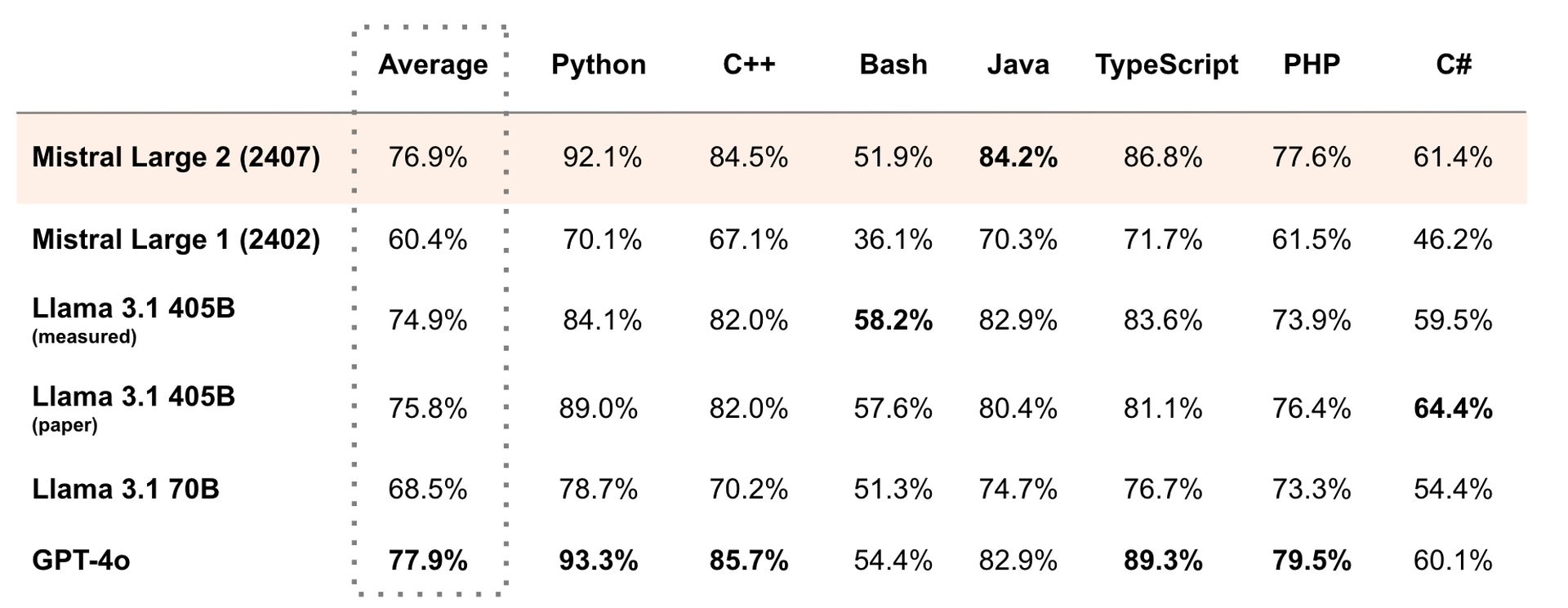

- Attività di codifica: Nel benchmark HumanEval, che testa le capacità di programmazione, Mistral Large 2 mostra un’elevata competenza, con prestazioni paragonabili a modelli leader come GPT-4. Ciò indica la sua capacità di comprendere e generare codice in modo efficace.

- Risoluzione di problemi matematici: Il modello si comporta bene nel benchmark MATH, che valuta le capacità di risoluzione dei problemi matematici. Sebbene si classifichi appena dietro GPT-4, le sue prestazioni riflettono la sua capacità di gestire calcoli complessi e attività logiche.

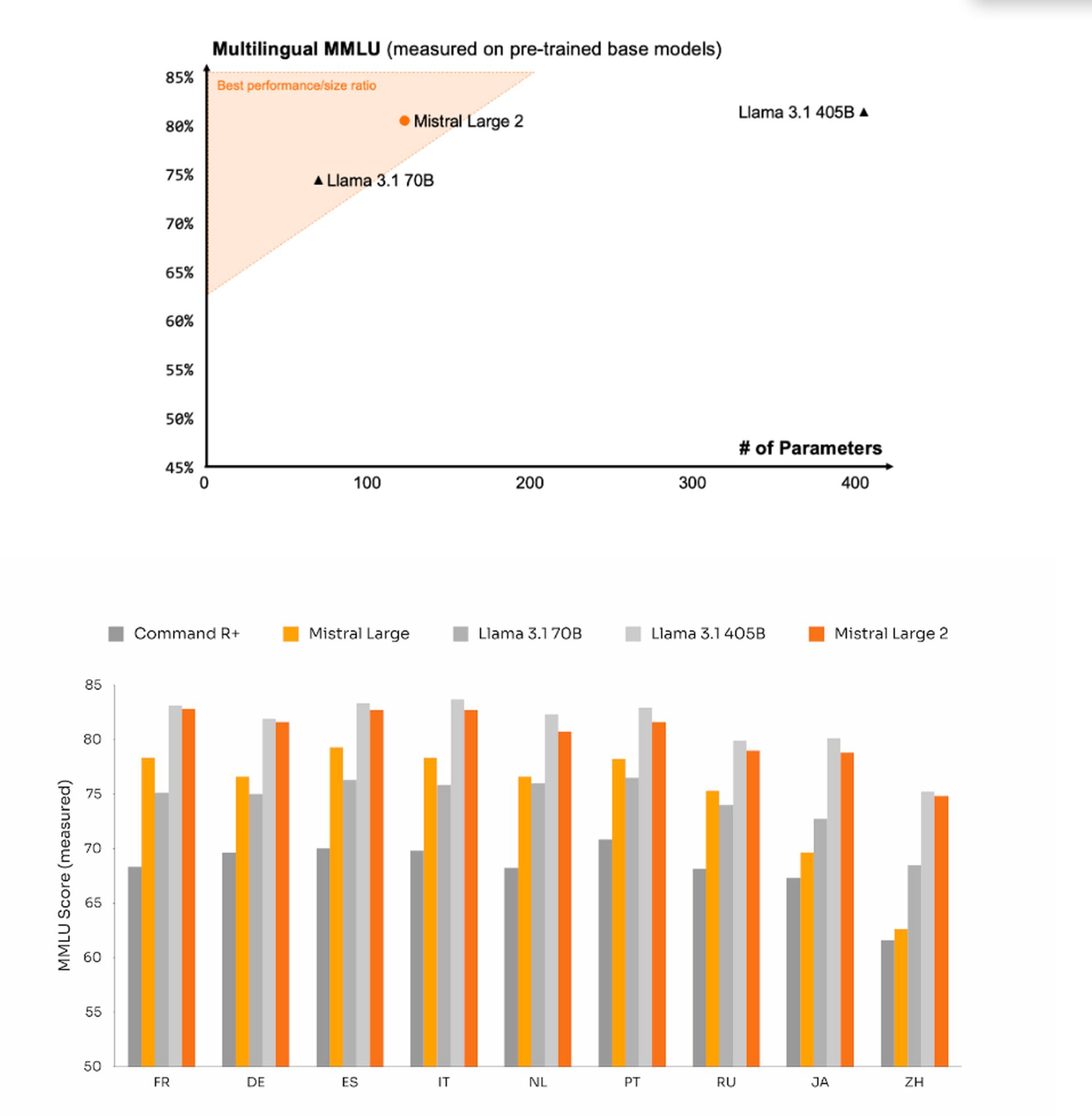

- Prestazioni multilingue:Nel test Multilingual MMLU, Mistral Large 2 eccelle in più lingue, dimostrando la sua capacità di elaborare e generare testo in vari contesti linguistici.

Specifiche tecniche

Mistral Large 2 è progettato per funzionare in modo efficiente nonostante le sue grandi dimensioni. Può essere eseguito su una singola macchina, il che è significativo date le sue dimensioni. Questa efficienza è vantaggiosa per le applicazioni che richiedono l’elaborazione rapida di grandi quantità di testo.

Capacità di codifica

Il modello supporta oltre 80 linguaggi di programmazione, tra cui quelli più diffusi come Python, Java, C, C++, JavaScript e Bash. Questo ampio supporto è il risultato di una formazione approfondita incentrata sulle attività di programmazione, rendendo Mistral Large 2 uno strumento versatile per sviluppatori e per chi lavora con il codice.

Capacità multilingue

Mistral Large 2 è in grado di elaborare e generare testo in numerose lingue, tra cui:

- Lingue europee: francese, tedesco, spagnolo, italiano, portoghese

- Lingue asiatiche: arabo, hindi, russo, cinese, giapponese, coreano

Questo ampio supporto linguistico consente al modello di gestire varie attività e applicazioni multilingue.

La parte mancante

Mistral Large 2 non offre attualmente capacità multimodali, che implicano l’elaborazione simultanea di testo e immagini. Questa è un’area in cui altri modelli, come quelli di OpenAI, hanno attualmente un vantaggio. Sviluppi futuri potrebbero colmare questa lacuna.

Come usare Mistral Large 2

Mistral Large 2 è disponibile su diverse piattaforme, tra cui:

Per la sperimentazione, Mistral offre anche l’accesso tramite il suo concorrente ChatGPT, le Chat. Tuttavia, mentre il modello è più accessibile di alcuni concorrenti, non è open source e l’uso commerciale richiede una licenza a pagamento.

Quindi, il nuovo modello Large 2 di Mistral è abbastanza grande?

Il modello Large 2 di Mistral è davvero molto grande, con 123 miliardi di parametri, il che lo rende uno dei modelli linguistici più estesi disponibili. Questa scala gli consente di gestire attività di generazione di testo complesse e di mantenere la coerenza su lunghi passaggi. La sua finestra di contesto da 128.000 token migliora ulteriormente la sua capacità di elaborare e generare documenti dettagliati e lunghi.

Oltre alle sue dimensioni, Mistral Large 2 è stato ottimizzato per ridurre al minimo problemi come la generazione di informazioni errate, migliorandone l’affidabilità. Ha anche buone prestazioni in vari benchmark, tra cui la codifica e la risoluzione di problemi matematici, e supporta più linguaggi. Quindi, sì, Mistral Large 2 è incredibilmente grande e capace, soddisfacendo le esigenze di molte applicazioni AI avanzate.

Source: Il nuovo modello Large 2 di Mistral è abbastanza grande?