La controversia sul porno con l’intelligenza artificiale di Taylor Swift ha scatenato un acceso dibattito sull’uso della tecnologia deepfake e sulle sue potenziali minacce per la società. L’incidente, che coinvolgeva false immagini sessualmente esplicite di Taylor Swift diventate virali sui social media, evidenzia l’urgente necessità di regolamentazione ed etica nell’uso dell’intelligenza artificiale.

Il porno AI di Taylor Swift innesca un cambiamento cruciale

La controversia sul porno con l’intelligenza artificiale di Taylor Swift ha il potenziale per innescare un cambiamento positivo nel modo in cui regoliamo e comprendiamo la tecnologia deepfake. L’ampia condivisione di queste immagini false ha attirato l’attenzione dei politici e dei fan statunitensi, con il rappresentante statunitense Joe Morelle che ha descritto la situazione come “spaventosa”. Le immagini sono state visualizzate milioni di volte sui social media, con un’immagine che ha ricevuto 47 milioni di visualizzazioni prima di essere rimossa. Le piattaforme di social media hanno adottato misure per affrontare il problema, ma l’incidente evidenzia la necessità di un approccio più completo alla regolamentazione dei contenuti deepfake.

L’uso della tecnologia deepfake

La tecnologia Deepfake è un sottoinsieme dell’intelligenza artificiale che ha la capacità di creare immagini e video realistici ma completamente fabbricati. Inizialmente era visto come uno strumento di intrattenimento e creatività innocua. Tuttavia, divenne presto un’arma di sfruttamento personale e diffuso. La facilità con cui vengono creati e condivisi i deepfake mette alla prova le nozioni di verità e autenticità nello spazio digitale. Alimentare la disinformazione può portare a una diffusa confusione e sfiducia, soprattutto in ambiti sensibili come la politica, il giornalismo e l’opinione pubblica.

Minaccia per l’umanità

L’incidente pornografico con l’intelligenza artificiale di Taylor Swift evidenzia una tendenza più ampia e inquietante: la crescente minaccia dell’intelligenza artificiale per l’umanità. La capacità dell’intelligenza artificiale di manipolare la realtà è un problema per la privacy e una minaccia per la società. Il fatto che l’intelligenza artificiale possa essere utilizzata per prendere di mira gli individui in modo così personale e invasivo evidenzia la crisi etica alla base di questa tecnologia.

La necessità di una regolamentazione

L’incidente pornografico con l’intelligenza artificiale di Taylor Swift evidenzia la necessità di linee guida e regolamenti etici per governare lo sviluppo e l’uso dell’intelligenza artificiale. Dovrebbero essere implementate leggi esaustive per regolamentare la creazione e la distribuzione di contenuti deepfake, soprattutto quando si tratta di pornografia non consensuale. Inoltre, le soluzioni tecnologiche, come gli strumenti di rilevamento dell’intelligenza artificiale, sono cruciali per rilevare e segnalare i contenuti deepfake. Sono inoltre necessarie campagne di sensibilizzazione pubblica per educare le persone sulla natura dei deepfake e sull’importanza di verificare i contenuti digitali.

La legalità delle immagini porno AI di Taylor Swift

La legalità delle immagini porno basate sull’intelligenza artificiale di Taylor Swift, come quelle di Taylor Swift, varia in modo significativo da giurisdizione a giurisdizione. Negli Stati Uniti, il quadro giuridico è lacunoso e largamente inefficace a livello federale. Solo 10 stati hanno leggi specifiche contro la creazione e la distribuzione di pornografia deepfake. Questa mancanza di una legislazione esaustiva lascia le vittime come Swift in un limbo legale su come procedere contro tali violazioni.

La proposta di legge sull’intelligenza artificiale dell’Unione europea e il regolamento generale sulla protezione dei dati (GDPR) mirano a regolamentare i contenuti generati dall’intelligenza artificiale, come i deepfake. Il GDPR richiede il consenso per l’utilizzo di dati personali, come immagini o suoni, per creare contenuti. Tuttavia, queste normative incontrano ostacoli nell’applicazione, soprattutto per quanto riguarda i creatori anonimi e i confini internazionali.

L’incidente pornografico con l’intelligenza artificiale di Taylor Swift è un campanello d’allarme. Evidenzia il lato oscuro dell’intelligenza artificiale e la necessità di solidi quadri giuridici e tecnologici per proteggere i diritti individuali e sostenere gli standard etici nell’era digitale. È giunto il momento che i politici, i tecnologi e la società in generale si uniscano per affrontare le sfide poste dalla tecnologia deepfake. Dobbiamo garantire che l’intelligenza artificiale serva l’umanità in modo positivo piuttosto che come strumento di sfruttamento e danno.

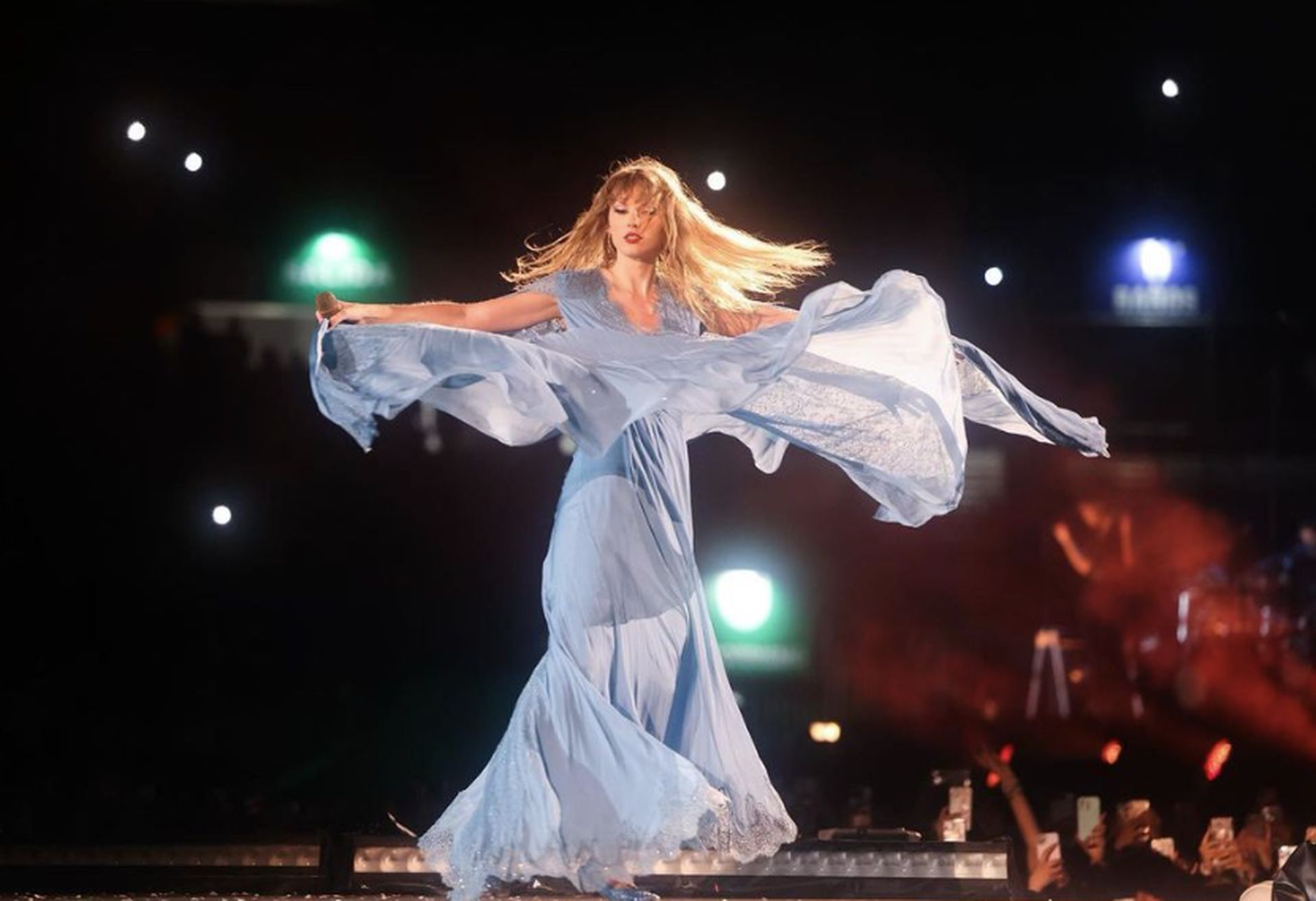

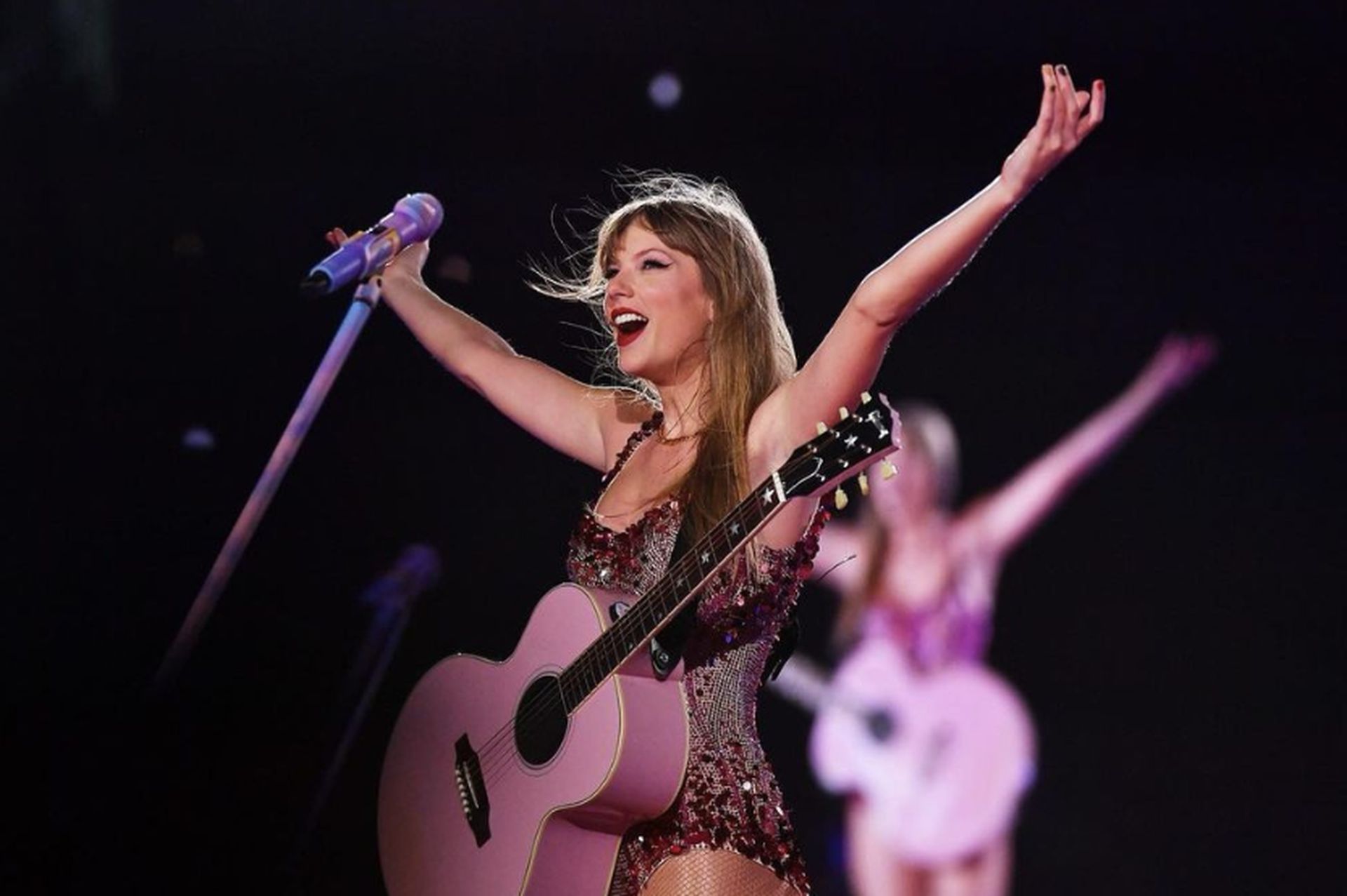

Credito immagine in primo piano: Taylor Swift/Instagram

Source: L’incidente di Taylor Swift evidenzia l’urgenza di fermare la minaccia deepfake