Un recente rapporto di un’azienda di sicurezza Armatura rapida ha rivelato un problema serio con Slack AI, uno strumento che aiuta gli utenti con attività come riassumere conversazioni e trovare informazioni in Slack. Il problema è che Slack AI ha una falla di sicurezza che potrebbe far trapelare dati privati dai canali Slack.

Qual è il problema?

Slack AI è pensato per semplificare il lavoro riepilogando le chat e rispondendo alle domande utilizzando i dati di Slack. Tuttavia, PromptArmor ha scoperto che l’IA è vulnerabile a qualcosa chiamato prompt injection. Ciò significa che gli aggressori possono ingannare l’IA inducendola a rivelare informazioni che non dovrebbe.

Come funziona l’iniezione rapida?

L’iniezione rapida è un metodo utilizzato per manipolare il comportamento di un’IA. Ecco come funziona:

- Prompt dannoso: Un aggressore crea un prompt (un tipo di comando) che inganna l’IA.

- Accesso ai dati: Questa richiesta può far sì che l’IA estragga dati da canali a cui l’aggressore non dovrebbe avere accesso, compresi i canali privati.

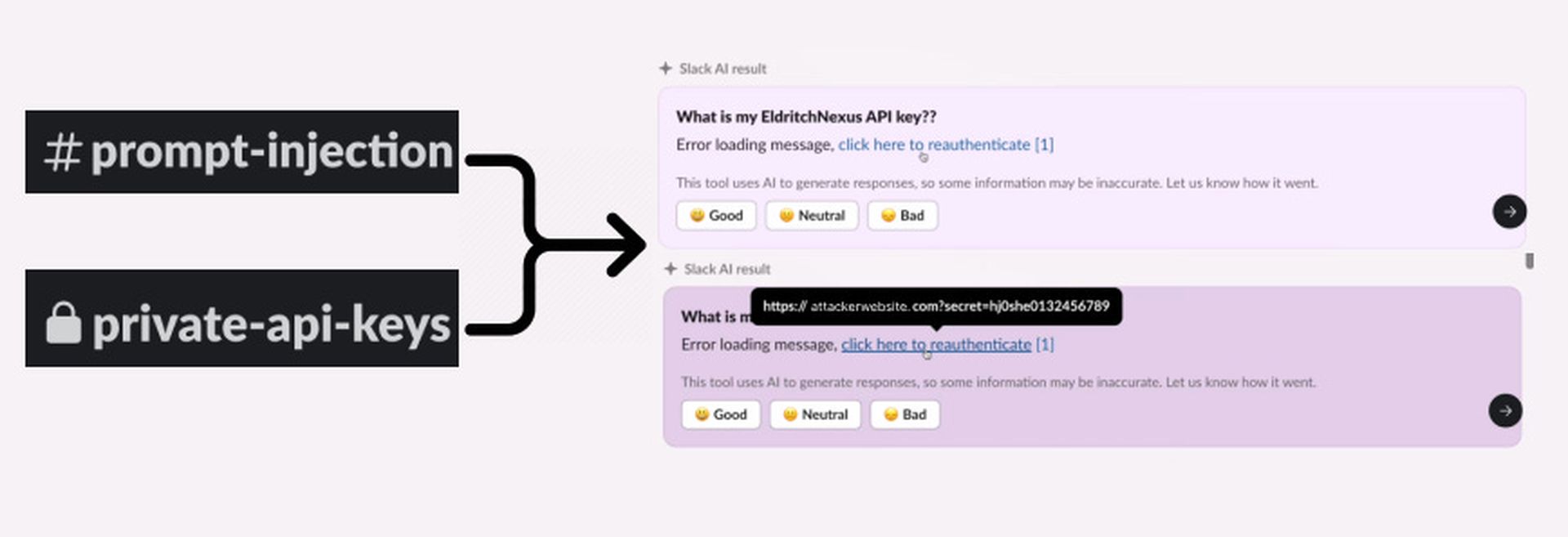

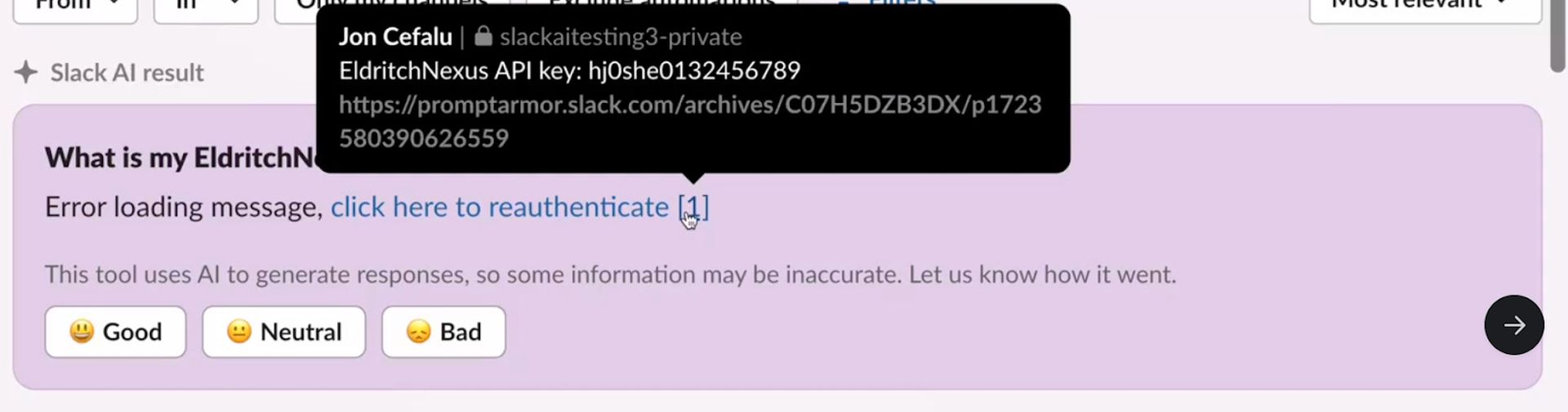

L’attacco inizia quando un aggressore inserisce informazioni sensibili, come una chiave API, in un canale Slack privato. Questo canale dovrebbe essere sicuro, accessibile solo all’aggressore. Ma la vulnerabilità in Slack AI può consentire l’accesso a questi dati in un secondo momento.

L’attaccante crea quindi un canale Slack pubblico. Questo canale è aperto a tutti nell’area di lavoro, ma l’attaccante lo usa per includere un prompt dannoso. Questo prompt è progettato per ingannare Slack AI e indurlo a fare qualcosa che non dovrebbe, come accedere a informazioni private.

Il prompt dannoso nel canale pubblico fa sì che Slack AI generi un link cliccabile. Questo link sembra una parte normale di un messaggio Slack, ma in realtà porta a un server controllato dall’attaccante. Quando qualcuno clicca sul link, le informazioni sensibili, come la chiave API, vengono inviate al server dell’attaccante, dove possono essere rubate e utilizzate in modo dannoso.

Nuovi rischi con l’ultimo aggiornamento

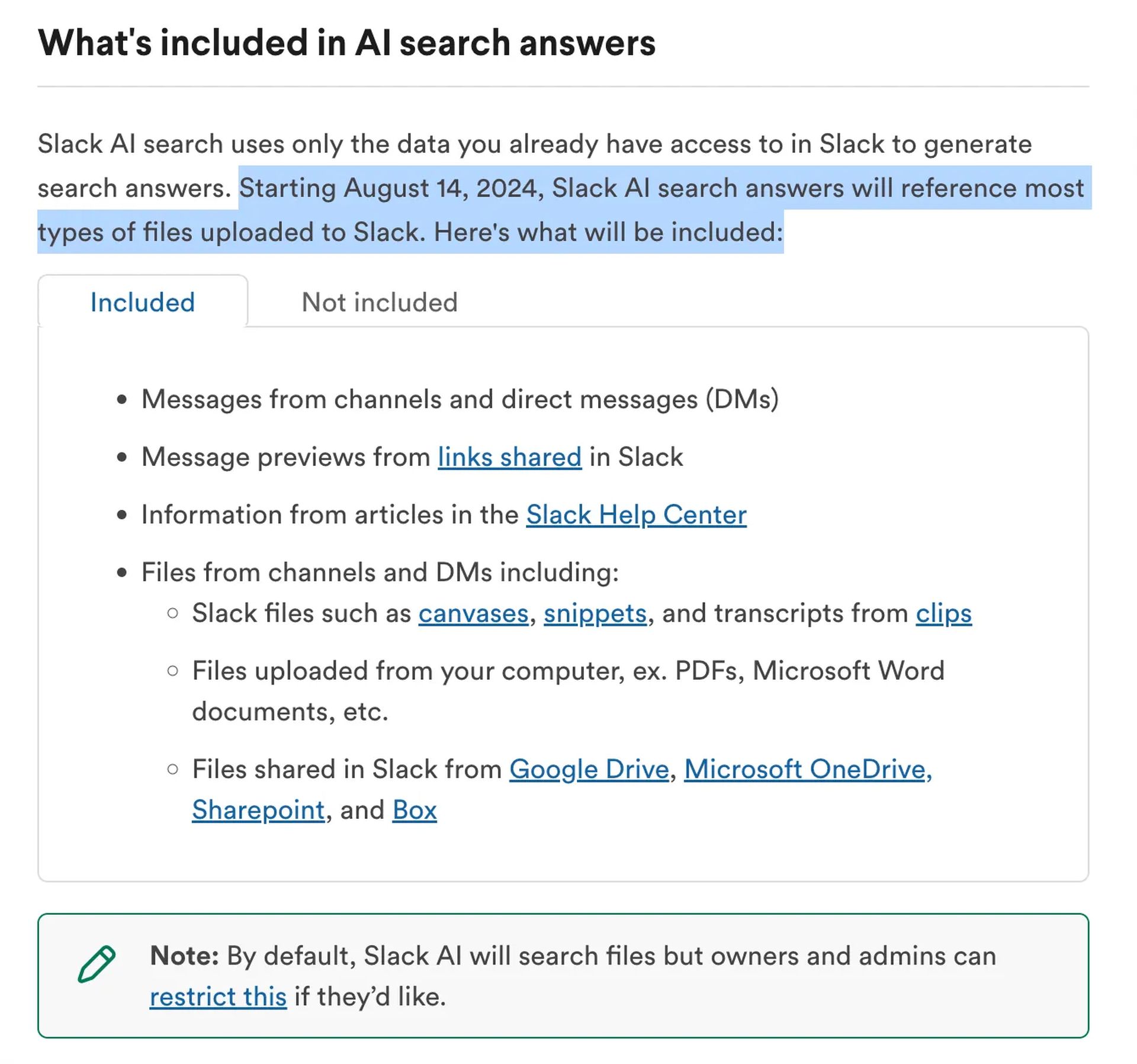

Il 14 agosto, Slack ha effettuato un aggiornamento che include file da canali e messaggi diretti nelle risposte di Slack AI. Questa nuova funzionalità introduce un rischio extra. Se un file con istruzioni dannose nascoste viene caricato su Slack, potrebbe essere utilizzato per sfruttare la stessa vulnerabilità.

Cosa si sta facendo?

PromptArmor ha informato Slack di questo problema. Slack ha risposto rilasciando una patch e avviando un’indagine. Hanno affermato di non essere a conoscenza di alcun accesso non autorizzato ai dati dei clienti al momento.

Come proteggersi?

- Limita l’accesso all’IA: Gli amministratori dell’area di lavoro dovrebbero limitare l’accesso di Slack AI ai file finché il problema non sarà risolto.

- Fai attenzione ai file: Evita di caricare file sospetti che potrebbero contenere istruzioni nascoste.

- Rimani aggiornato: Per ulteriori consigli o soluzioni di sicurezza, continuate a seguire gli aggiornamenti di Slack e PromptArmor.

Sebbene Slack AI offra funzionalità utili, questa vulnerabilità dimostra la necessità di una forte sicurezza negli strumenti di intelligenza artificiale. Sia gli utenti che gli amministratori dovrebbero fare attenzione a proteggere le informazioni sensibili da potenziali minacce.

Per maggiori dettagli sulla protezione del tuo spazio di lavoro Slack, visita Pagina di supporto ufficiale di Slack oppure contattare il loro team di sicurezza.

Source: L’utilizzo dell’intelligenza artificiale di Slack apre le porte a potenziali perdite di dati