L’intelligenza artificiale (AI) ha fatto progressi incredibili negli ultimi anni. Tuttavia, capire cos’è un’allucinazione dell’intelligenza artificiale e come superarla è ancora un processo in corso per i creatori di LLM.

La tecnologia di oggi e di domani continua ad affascinare tutti noi, soprattutto quando si tratta di come l’intelligenza artificiale possa comprendere e generare il linguaggio umano. Sono stati fatti enormi passi avanti con i Large Language Models (LLM), programmi informatici addestrati su enormi quantità di testo. Questi LLM possono scrivere diversi tipi di formati di testo creativi, come poesie, codici, script, brani musicali, e-mail, lettere, ecc.

Tuttavia, c’è un problema peculiare che sorge con la potenza di questi modelli impressionanti: a volte hanno “allucinazioni”.

Cos’è un’allucinazione dell’intelligenza artificiale?

Proprio come gli esseri umani possono immaginare o sognare cose che non sono reali, l’intelligenza artificiale può fare qualcosa di simile. Le allucinazioni dell’intelligenza artificiale si verificano quando un LLM produce un testo che sembra credibile ma di fatto sbagliato. Queste allucinazioni possono variare da piccoli errori a storie completamente inventate e affermazioni senza senso.

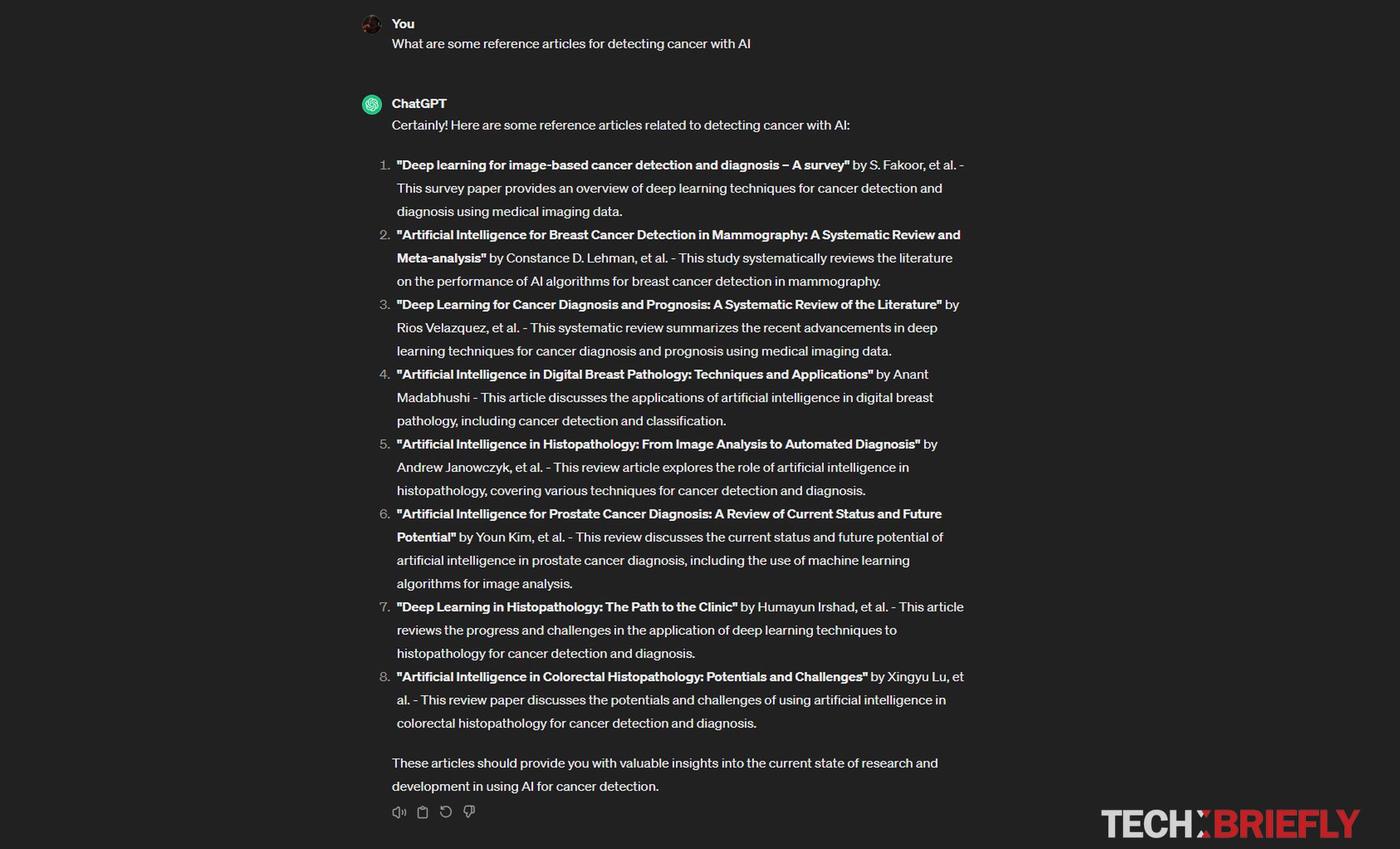

Per comprendere meglio questo problema, diamo un’occhiata ad alcuni esempi:

- Mescolare i fatti: un’intelligenza artificiale a cui viene chiesto di scrivere un articolo su un evento potrebbe includere date e luoghi errati o travisare le persone coinvolte.

- Creare falso informazioni: un’intelligenza artificiale incaricata di scrivere una descrizione del prodotto potrebbe inventare funzionalità che il prodotto in realtà non ha.

- Sicuramente sbagliato: La cosa davvero complicata delle allucinazioni dell’intelligenza artificiale è che spesso vengono presentate in modo molto convincente, rendendo difficile distinguerle dalle informazioni reali.

Perché le allucinazioni sono un problema per gli LLM?

Come puoi vedere dalle nostre spiegazioni su cosa sia un’allucinazione AI, rappresentano un problema significativo per gli LLM per diversi motivi. In primo luogo, se le persone non possono fidarsi del testo generato da un LLM, perdono fiducia nell’utilità e nell’affidabilità complessive della tecnologia. Immagina di leggere un riassunto online di una notizia scritta da un LLM. Se il riepilogo contiene errori fattuali, potresti smettere del tutto di utilizzare quella fonte. Questo può rappresentare un grosso problema per qualsiasi applicazione che si affida agli LLM per generare testo, come chatbot, assistenti virtuali o strumenti automatizzati per la creazione di contenuti.

In secondo luogo, le allucinazioni legate all’intelligenza artificiale potrebbero contribuire alla diffusione della disinformazione. In un’epoca in cui le notizie false sono già una delle principali preoccupazioni, il testo generato dall’intelligenza artificiale che sembra credibile potrebbe facilmente essere scambiato per informazioni reali. Ciò potrebbe avere un impatto negativo su tutto, dal discorso pubblico a importanti processi decisionali. Ad esempio, immagina un LLM che crea post sui social media su un candidato politico che contiene informazioni false.

Questi post potrebbero fuorviare gli elettori e influenzare l’esito delle elezioni. Questo è il motivo esatto per cui Google ha disabilitato la capacità di Gemini di rispondere alle domande relative alle elezioni.

In terzo luogo, le aziende o le organizzazioni che utilizzano LLM potrebbero subire danni alla reputazione se i loro sistemi di intelligenza artificiale producessero contenuti imprecisi o dannosi. Supponiamo che un’azienda utilizzi un LLM per scrivere le descrizioni dei prodotti per il proprio negozio online. Se il LLM inventa caratteristiche che i prodotti in realtà non hanno, ciò potrebbe portare all’insoddisfazione dei clienti e danneggiare la reputazione dell’azienda.

Perché si verificano le allucinazioni dell’intelligenza artificiale?

Adesso hai qualche idea su cosa sia un’allucinazione dell’intelligenza artificiale, ma perché accadono? Diversi fattori contribuiscono a questo problema:

- Come vengono addestrati: Gli LLM ricevono enormi quantità di dati di testo. Questi dati spesso contengono errori, distorsioni e informazioni obsolete. L’intelligenza artificiale impara da questi dati proprio come fa dalle informazioni corrette.

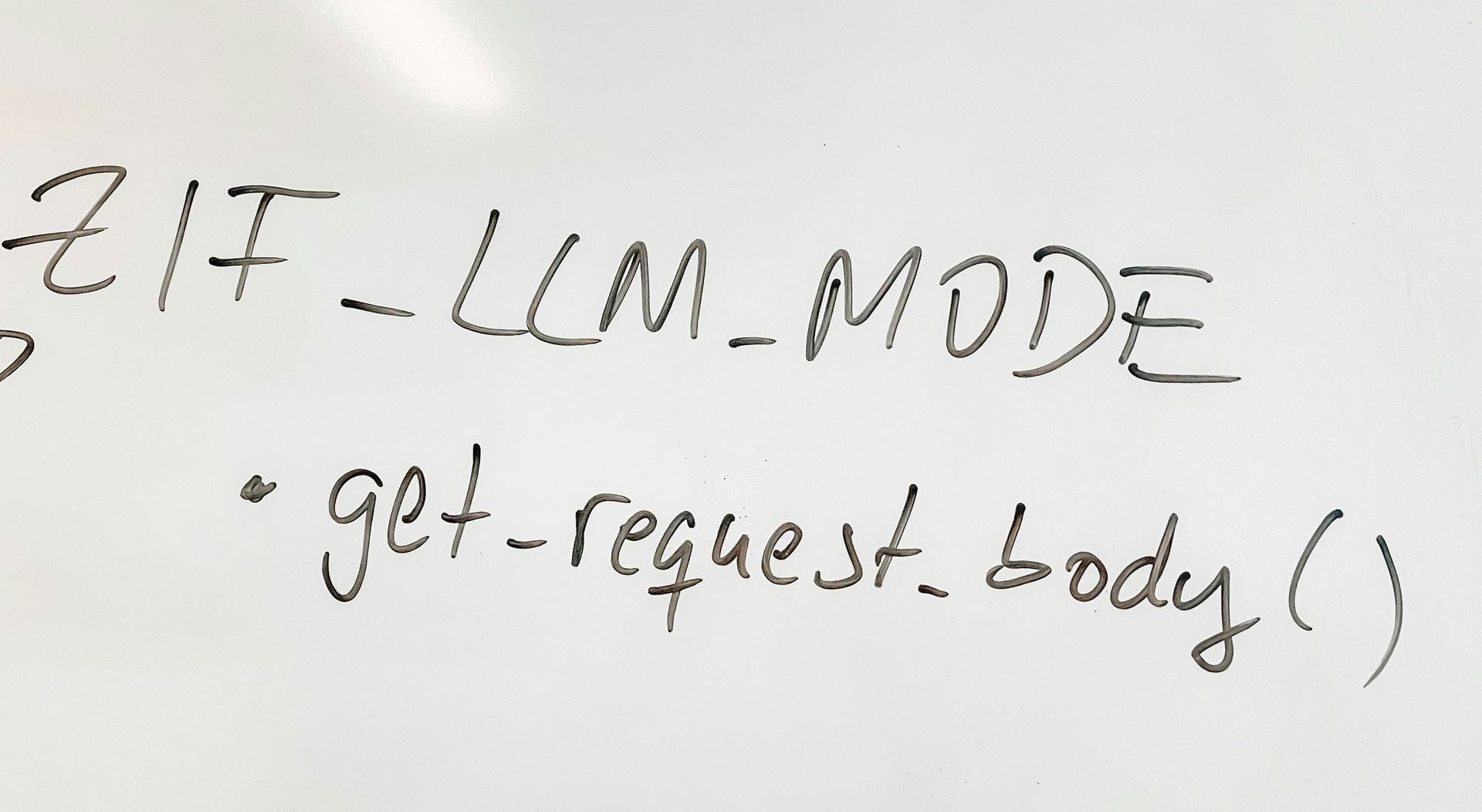

- Comprendere vs creare: Gli LLM sono bravi a comprendere i modelli linguistici, ma non sempre hanno una solida conoscenza dei concetti o della logica del mondo reale. Possono generare qualcosa che sembra plausibile senza che sia effettivamente vero.

- La ricerca della fluidità: Gli LLM sono progettati per produrre testo che suoni naturale e simile a quello umano. A volte, questo significa “riempire gli spazi vuoti” laddove potrebbero esserci lacune nella conoscenza dell’IA. Questi spazi vuoti possono portare l’intelligenza artificiale a creare contenuti.

Cosa si sta facendo per risolvere questo problema?

Ricercatori e sviluppatori nella comunità dell’intelligenza artificiale stanno lavorando attivamente su modi per ridurre le allucinazioni dell’intelligenza artificiale.

Alcuni degli approcci includono:

- Dati di allenamento migliori: creazione di set di dati attentamente curati che hanno meno probabilità di contenere errori e pregiudizi, portando a un migliore comportamento dell’intelligenza artificiale.

- Verifica dei fatti: sviluppo di tecniche per effettuare riferimenti incrociati al testo generato dall’intelligenza artificiale con fonti affidabili, garantendone l’accuratezza.

- Spiegabilità: Progettare LLM in grado di spiegare il loro processo di ragionamento, il che rende più facile individuare potenziali errori

- Collaborazione uomo-intelligenza artificiale: Costruire sistemi in cui gli esseri umani e l’intelligenza artificiale lavorano insieme, rendendo più facile identificare e correggere le allucinazioni.

Oltre a tutto ciò, Jensen Huang di Nvidia afferma che le allucinazioni legate all’intelligenza artificiale possono essere curate entro i prossimi 5 anni.

Pertanto, le allucinazioni dell’intelligenza artificiale sono una sfida complessa, ma è cruciale da superare se gli LLM vogliono raggiungere il loro pieno potenziale. Man mano che le tecnologie per ridurre le allucinazioni diventano più sofisticate, promettono di rendere i LLM uno strumento molto più affidabile e prezioso per compiti di comunicazione, creatività e conoscenza.

Credito immagine in primo piano: vackground.com/Unsplash